Warum ist es für maschinelles Sehen schwierig, hochpräzise Dimensionskontrollen durchzuführen?

In der sich schnell entwickelnden Landschaft der industriellen Automatisierung und Qualitätskontrolle hat sich die Maschinenvision zu einem leistungsstarken Werkzeug für verschiedene Inspektionsaufgaben entwickelt. Doch trotz vieler Vorteile bleibt es eine große Herausforderung, präzise Dimensionsprüfungen durchzuführen. Dieser Artikel untersucht die wichtigsten Gründe für die Schwierigkeit, genaue dimensionsbezogene Messungen mittels Maschinenvision zu erreichen.

Hardware-bedingte Einschränkungen

Die Hardware-Komponenten eines Maschinenvisionsystems, einschließlich Kameras und Linsen, legen inherent Grenzen für die Präzision fest. Kameras mit geringerer Auflösung können feine Details von Objekten nicht erfassen, was zu ungenauen Dimensionsberechnungen führt. Selbst bei hochauflösenden Kameras ist die Pixelgröße ein entscheidender Faktor. Kleinere Pixel können theoretisch detailliertere Bilder liefern, reduzieren aber auch die Menge an pro Pixel aufgenommenem Licht, was das Bildrauschen erhöht. Dieses Rauschen kann die Kanten von Objekten verzerrten, wodurch es schwierig wird, deren Grenzen präzise zu definieren.

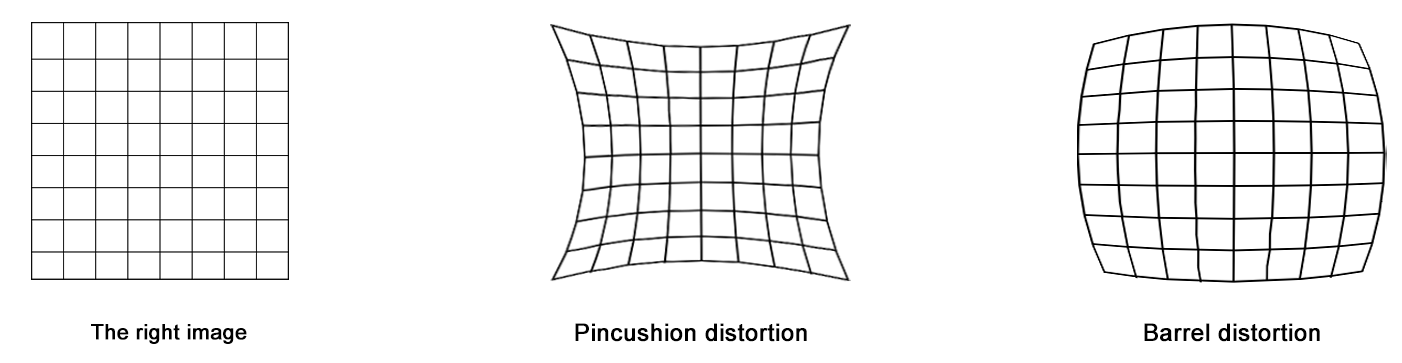

Industrielles Optik auch spielt eine entscheidende Rolle in der Genauigkeit von Maschenvision. Geometrische Verzerrungen, wie Fass- und Kissenverzerrungen, sind in Linsen verbreitet. Diese Verzerrungen verursachen, dass geradlinige Linien in der realen Welt in den aufgenommenen Bildern gekrümmt erscheinen, was die Genauigkeit der Dimensionsmessung erheblich beeinträchtigen kann. Zudem können Linsen an chromatischer Abberation leiden, wobei verschiedene Wellenlängen des Lichts an unterschiedlichen Punkten fokussiert werden, was zu Farbrändern um Objekte führt und die Messgenauigkeit weiter verschlechtert. Die Korrektur dieser Linsenmängel erfordert komplexe Kalibrierungsverfahren, und das Erreichen einer vollständigen Korrektur über das gesamte Blickfeld ist äußerst schwierig.

Physikalische Grenzen der Optik

Die physikalischen Prinzipien der Optik stellen fundamentale Hindernisse für hochgenaue Dimensionsprüfungen in der Maschinenvision dar. Lichtdifferaktion ist ein wichtiges Problem. Gemäß den Gesetzen der Optik tritt Differaktion auf, wenn Licht durch kleine Öffnungen oder um kleine Objekte herum fließt, was dazu führt, dass die Kanten des Objektsbildes unscharf werden. Bei der Prüfung kleiner Komponenten kann dieser Differaktionseffekt es unmöglich machen, dicht beieinander liegende Merkmale genau zu unterscheiden, was zu Fehlern bei der Dimensionsmessung führen kann.

Eine weitere optische Begrenzung ist die begrenzte Schärfentiefe. In der Maschinenvision kann es passieren, dass, wenn das Objekt komplexe dreidimensionale Formen hat oder wenn es Schwankungen in der Position des Objekts relativ zur Kamera gibt, Teile des Objekts außer Fokus liegen. Diese Unschärfe kann das Erscheinungsbild des Objekts verzerren und es schwierig machen, Dimensionen genau zu messen. Die Anpassung der Schärfentiefe beinhaltet oft Kompromisse; eine Erhöhung der Schärfentiefe kann die Auflösung verringern, während eine Steigerung der Auflösung die Schärfentiefe verengen kann.

Umwelteinflüsse

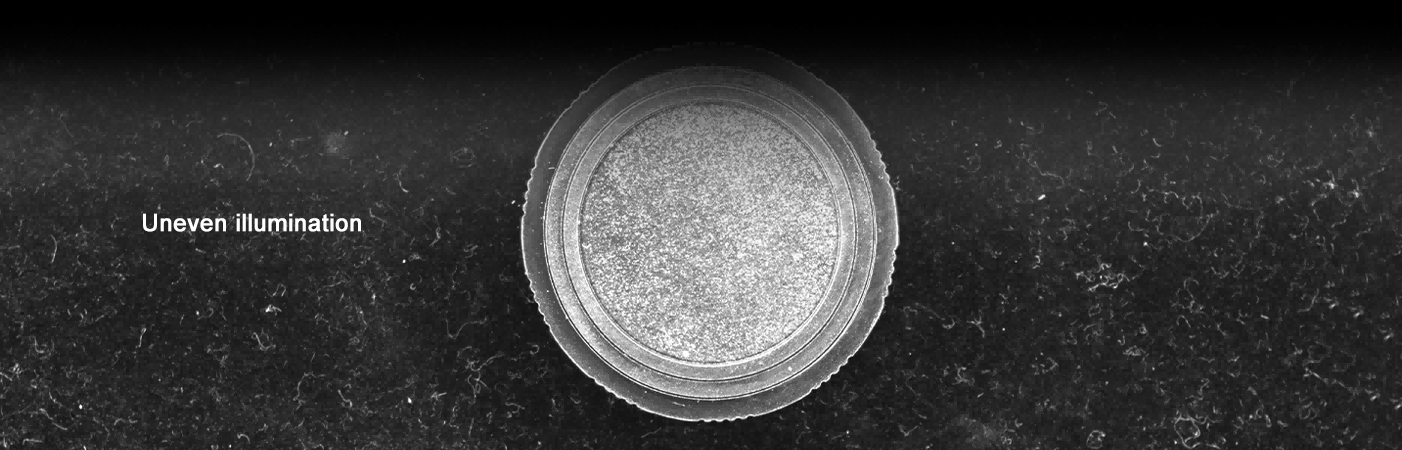

Die Umgebung, in der Maschinenvisionsysteme betrieben werden, kann einen erheblichen Einfluss auf die Genauigkeit der Dimensionsprüfung haben. Beleuchtungsbedingungen sind stark variabel und kritisch. Änderungen der Beleuchtungsintensität, -richtung und -färtemperatur können das Erscheinungsbild von Objekten in Bildern verändern. Zum Beispiel kann ungleichmäßige Beleuchtung Schatten auf dem Objekt erzeugen, die falsch als Teil der Form des Objekts interpretiert werden könnten, was zu fehlerhaften Dimensionsberechnungen führt. Reflexive Oberflächen am Objekt können auch Glanzstellen verursachen, die den Kamerasensor sättigen und wichtige Merkmale überdecken können.

Umgebungstemperatur und Luftfeuchtigkeit können ebenfalls die Leistungsfähigkeit von Maschinenvisionsystemen beeinflussen. Temperaturschwankungen können thermische Ausdehnung oder Kontraktion sowohl des geprüften Objekts als auch der Hardware-Komponenten des Visionsystems verursachen, was zu dimensionellen Veränderungen führt. Feuchtigkeit kann Kondenswasser auf Linsen oder anderen optischen Komponenten verursachen, was die Bildqualität und die Messgenauigkeit verschlechtert.

Objektfläche - Ausgelöste Herausforderungen

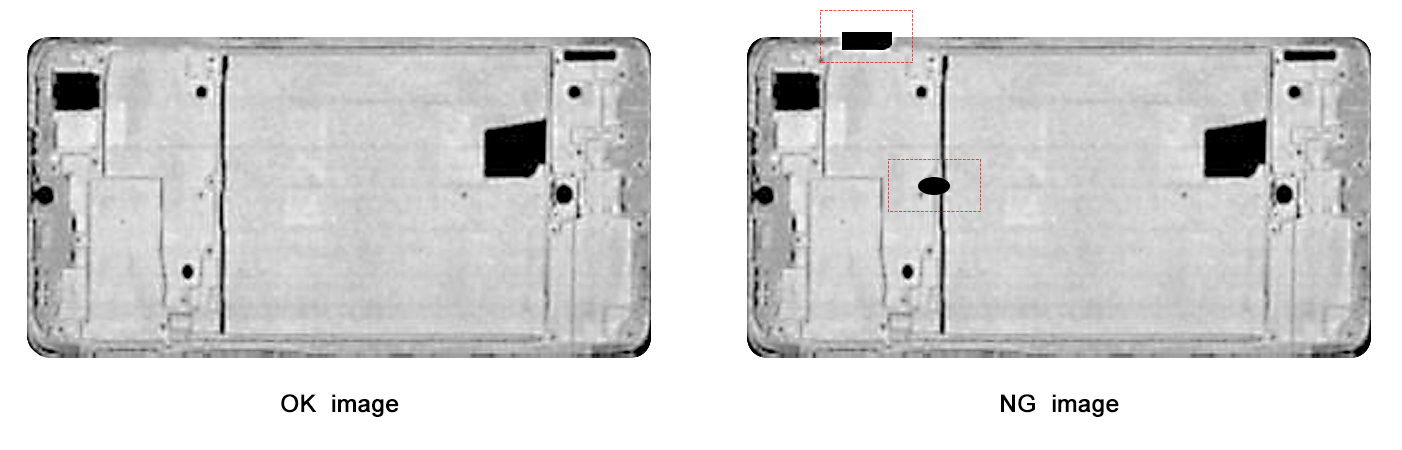

Die Flachheit eines Objekts ist ein oft übersehener, aber signifikanter Faktor, der die Genauigkeit von auf maschinellem Sehen basierenden Dimensionsprüfungen beeinträchtigt. Wenn eine Oberfläche uneben ist, wird die Wechselwirkung zwischen Licht und Objekt unvorhersehbar. In Bereichen mit Buckeln oder Vertiefungen weicht die Lichtreflexion vom erwarteten Muster ab. Anstatt das Licht in einer konsistenten Richtung zur Kamera zu reflektieren, streuen unebene Oberflächen das Licht, was helle Stellen und Schatten erstellt, die nicht zur tatsächlichen Geometrie des Objekts passen. Diese inkonsistenten Beleuchtungsmuster können Kantendetektionsalgorithmen irreführen und dazu führen, dass sie die Grenzen des Objekts falsch identifizieren. Zum Beispiel kann eine kleine Erhebung auf ansonsten flacher Oberfläche als eigenständige Merkmalskante missverstanden werden, was zu übertreibten Maßeinheiten führt.

Darüber hinaus stören unebene Oberflächen in 3D-Maschinenvisionssystemen, die auf Techniken wie strukturiertem Licht oder Stereoabgleich basieren, die grundlegenden Prozesse der Tiefenwahrnehmung. Bei strukturiertem Licht werden die projizierten Muster auf einer unregelmäßigen Oberfläche verzerrt, was es schwierig macht, die Tiefeninformationen genau zu decodieren. In der Stereovision können Ungleichheiten in der Oberflächenebene zu Fehlern bei der Zuordnung entsprechender Punkte zwischen den beiden Kameraperspektiven führen, da die Unebenheiten Diskrepanzen erzeugen, die nicht den wirklichen Entfernungen entsprechen. Daher wird die Rekonstruktion der 3D-Form des Objekts mit hoher Genauigkeit zu einer außerordentlich schwierigen Aufgabe, was direkt die Genauigkeit der Dimensionsprüfung beeinträchtigt.

Algorithmische und Softwarebeschränkungen

Die Algorithmen und Software, die in der Maschinenvision für Dimensionsprüfungen verwendet werden, haben ihre eigenen Herausforderungen. Die Kantenerkennung, ein grundlegender Schritt bei der Bestimmung von Objektdimensionen, ist oft komplex und fehleranfällig. Verschiedene Kantenerkennungsalgorithmen wie Canny, Sobel oder Laplacian haben jeweils ihre Stärken und Schwächen. Rauschen im Bild kann zu falsch erkannten Kanten führen, während objekte mit geringem Kontrast zu übersehenen Kanten führen können.

Darüber hinaus ist das genaue Anpassen geometrischer Modelle an die erkannten Kanten, um Dimensionen zu berechnen, eine schwierige Aufgabe. Objekte können unregelmäßige Formen, Oberflächenfehler oder Variationen in der Textur aufweisen, was die Algorithmen verwirren kann. Zudem erfordert die Bearbeitung von Objekten mit komplexen dreidimensionalen Geometrien fortschrittliche 3D-Rekonstruktionsalgorithmen, die rechenintensiv sind und oft nicht die notwendige Genauigkeit bieten.

Zusammenfassend lässt sich sagen, dass die Schwierigkeit bei der Durchführung präziser Dimensionskontrollen mit maschinellem Sehen aus einer Kombination von Hardwarebeschränkungen, optischen Einschränkungen, Umgebungsstörungen, Problemen im Zusammenhang mit der Flachheit des Objekts und algorithmischen sowie softwarebasierten Herausforderungen resultiert. Die Bewältigung dieser Hindernisse erfordert kontinuierliche Forschung und Entwicklung in mehreren Bereichen, einschließlich Optik, Elektronik, Informatik und Materialwissenschaft. Durch die Behebung dieser Probleme können wir die Genauigkeit und Zuverlässigkeit von Systemen des maschinellen Sehens für Dimensionskontrollen verbessern und sie somit den immer strenger werdenden Anforderungen moderner industrieller Anwendungen gerecht werden lassen.