¿Cuántas cámaras industriales puede soportar un host en un sistema de visión?

En los sistemas de visión modernos, determinar cuántas cámaras puede soportar un solo host (por ejemplo, una computadora o servidor) es una pregunta crítica para el diseño del sistema, la escalabilidad y la optimización de costos. La respuesta depende de múltiples factores interrelacionados, incluidas las capacidades de hardware, la eficiencia del software, las especificaciones de las cámaras industriales y los requisitos de la aplicación. Este artículo explora estas variables clave y proporciona un marco para estimar la capacidad de cámaras en un sistema de visión.

1. Componentes de Hardware y su Impacto

El hardware del host es la base del soporte de cámaras, con dos aspectos clave que juegan un papel principal.

1.1 Unidades de Procesamiento: CPU y GPU

La CPU gestiona una amplia gama de tareas de procesamiento de imágenes, desde filtrado básico hasta inferencia de aprendizaje automático compleja. Las cámaras de alta resolución o con alta tasa de fotogramas generan grandes volúmenes de datos, tensionando la CPU. Las CPUs multi-núcleo, como la Intel i9 o AMD Threadripper, pueden distribuir las tareas entre núcleos para un procesamiento en paralelo. Por otro lado, las GPUs revolucionan los sistemas de visión acelerando el cálculo paralelo, especialmente crucial para tareas como la visión 3D y el aprendizaje profundo en la conducción autónoma. Las cámaras integradas con pipelines optimizados para GPU, como CUDA en GPUs NVIDIA, transfieren el procesamiento de la CPU, potencialmente triplicando el número de cámaras soportadas.

1.2 Memoria, Almacenamiento y E/O

Una cantidad suficiente de RAM es esencial para almacenar en búfer secuencias de video y datos procesados. Una cámara 4K a 30 FPS genera aproximadamente 300 MB/s de datos sin comprimir, lo que aumenta los requisitos de memoria en configuraciones con múltiples cámaras. Para cámaras de alta resolución, se debe asignar al menos 4-8 GB de RAM por cámara. El almacenamiento de alta velocidad, como SSD NVMe, y interfaces de E/S robustas como USB 3.2 y PCIe son vitales para la ingesta y almacenamiento de datos. Las interfaces heredadas pueden limitar severamente la escalabilidad del sistema.

2. Industrial Especificaciones de la Cámara

Los parámetros de las cámaras industriales influyen directamente en la carga del sistema anfitrión, principalmente mediante los siguientes dos factores críticos.

2.1 Resolución y Tasa de Fotogramas

Una mayor resolución y tasa de frames significa más datos para procesar. Una cámara 4K produce cuatro veces más píxeles que una cámara de 1080p, aumentando significativamente las demandas de procesamiento. De manera similar, una cámara de 120 FPS genera cuatro veces más datos que una de 30 FPS. En la retransmisión deportiva, se utilizan cámaras de alta resolución y alta tasa de frames, pero esto supone una carga extremadamente alta para el sistema anfitrión, requiriendo hardware potente para evitar la pérdida de calidad.

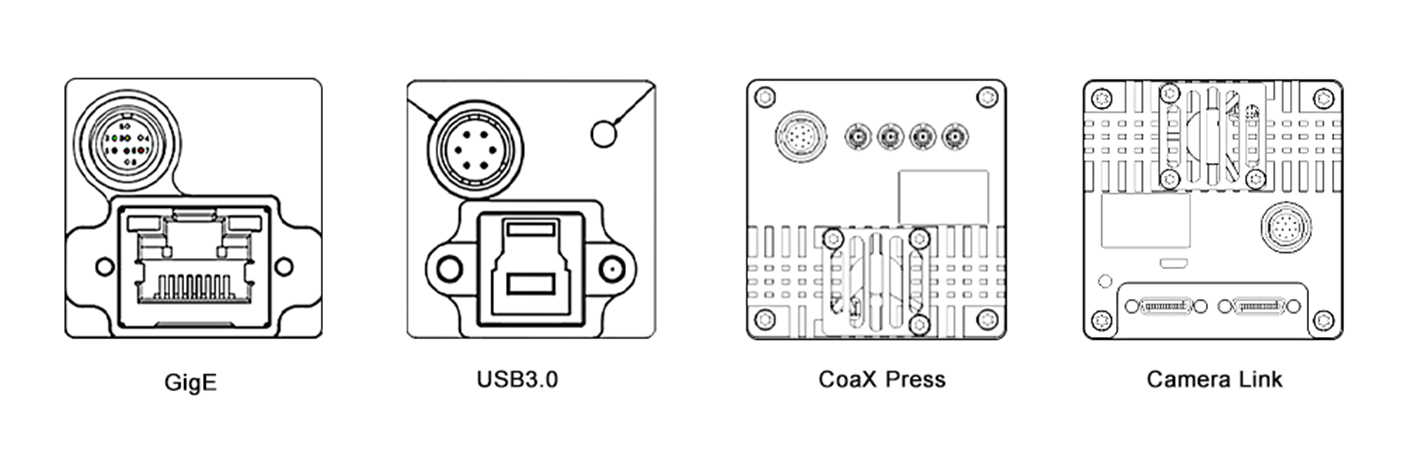

2.2 Compresión e Interfaz

La elección del formato de compresión afecta al tamaño de los datos y al costo de procesamiento. Los formatos comprimidos como H.264 reducen el ancho de banda, pero necesitan decodificación en el sistema anfitrión. Los formatos sin compresión ofrecen mayor fidelidad, pero consumen más recursos. Además, el tipo de interfaz de la cámara es crucial. Las interfaces de alta velocidad como GigE Vision y CoaXPress permiten una transferencia de datos eficiente en configuraciones con múltiples cámaras, mientras que las interfaces heredadas como USB 2.0 limitan la escalabilidad debido a su ancho de banda limitado.

3. Software y Canal de Procesamiento

La eficiencia del software es igualmente crítica, con estas dos áreas siendo clave para el rendimiento del sistema.

3.1 Sistema Operativo y Herramientas de Software

El sistema operativo y sus controladores forman la base del software. Los sistemas operativos en tiempo real (RTOS) minimizan la latencia, ideales para aplicaciones como el control robótico. Los sistemas basados en Linux son populares debido al soporte de código abierto. Los controladores optimizados mejoran el rendimiento del hardware. El software de visión y las bibliotecas, como OpenCV, MATLAB y marcos de aprendizaje profundo como TensorFlow y PyTorch, varían en eficiencia computacional. Por ejemplo, un host que ejecuta un modelo YOLO acelerado por GPU puede admitir menos cámaras que uno que utiliza detección básica de bordes debido a una mayor complejidad.

3.2 Multihilo y Optimización

La multiprogramación eficiente y la paralelización son clave para maximizar el rendimiento del sistema. La multiprogramación permite que las tareas se ejecuten de forma concurrente en los núcleos de la CPU, mientras que la paralelización aprovecha las GPU para el procesamiento de datos. Tecnologías como OpenMP y CUDA proporcionan marcos de trabajo para la implementación. En un sistema de vigilancia multicámara, OpenMP puede distribuir el procesamiento de las transmisiones de las cámaras entre los núcleos de la CPU, y CUDA puede acelerar el análisis de imágenes en la GPU, permitiendo manejar más cámaras.

4. Requisitos de Aplicación

La complejidad de la tarea de visión dicta la asignación de recursos, con el tiempo real y la complejidad de procesamiento siendo los principales determinantes.

4.1 Procesamiento en Tiempo Real vs. Procesamiento Offline

Las aplicaciones en tiempo real, como la conducción autónoma y la automatización industrial, requieren un procesamiento inmediato con baja latencia, limitando el número de cámaras que un host puede soportar. El procesamiento offline, como el análisis por lotes de videos, puede manejar más cámaras pero tiene resultados retrasados.

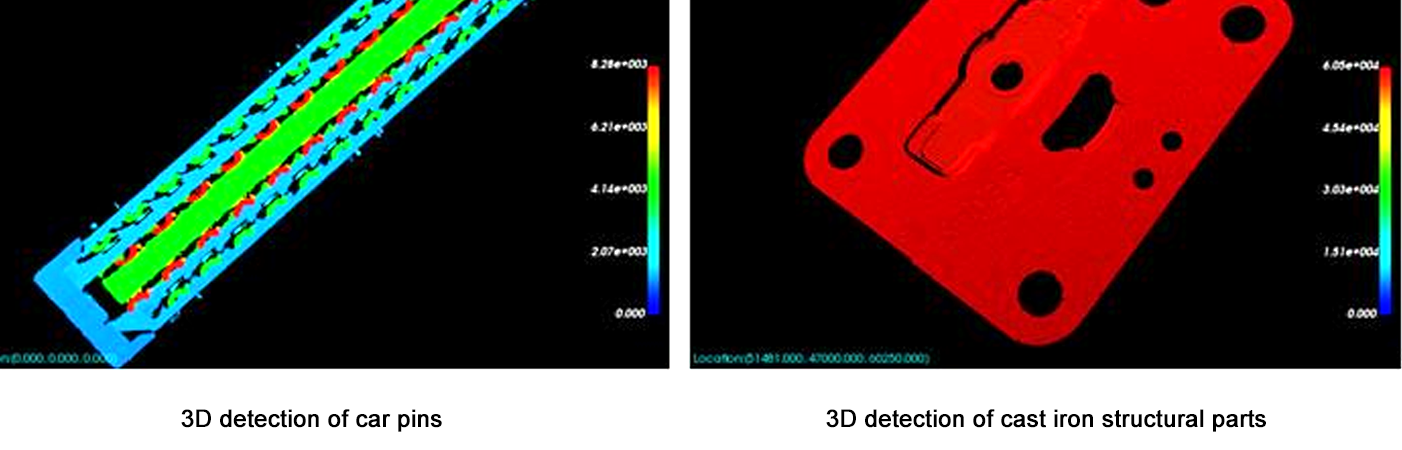

4.2 Complejidad de Procesamiento

Tareas simples como la detección de movimiento imponen una carga computacional baja, lo que permite a un host soportar más cámaras. Tareas complejas como la reconstrucción 3D o el reconocimiento facial avanzado requieren recursos significativos, reduciendo el número de cámaras soportadas. Por ejemplo, un host puede soportar 10 cámaras para la detección de movimiento pero solo 3 para la estimación en tiempo real de profundidad 3D.

5. Marco de Estimación

Utilice los siguientes pasos para estimar la capacidad de las cámaras:

Definir Parámetros de Cámara: Resolución, tasa de fotogramas, compresión e interfaz.

Calcular el Ancho de Banda: Tasa de Datos No Comprimidos = Resolución × Tasa de Fotogramas × Profundidad de Bits / 8 (por ejemplo, 1080p a 30 FPS = 1920×1080×30×24 / 8 = ~1.4 GB/s).

Evaluar Límites de Hardware: Asegúrese de que el poder de procesamiento de la CPU/GPU ≥ ancho de banda total × factor de sobrecarga de procesamiento (2–5× para tareas complejas).

Prueba con prototipos: Utiliza herramientas de referencia (por ejemplo, Intel VTune, NVIDIA Nsight) para medir el uso de recursos para una sola cámara, luego escala linealmente (con ajustes por las ganancias/pérdidas de paralelización).

Conclusión

El número de cámaras que un host puede soportar en un sistema de visión no es un número fijo, sino un equilibrio entre las capacidades del hardware, las especificaciones de la cámara, la optimización del software y la complejidad de la tarea. Para la mayoría de los sistemas, comenzar con un prototipo y escalar gradualmente mientras se monitorea el uso de recursos es el enfoque más confiable. A medida que el hardware (por ejemplo, GPUs más rápidas, aceleradores de IA) y el software (por ejemplo, marcos de computación periférica) continúan evolucionando a un ritmo rápido, la capacidad de soportar más cámaras con un rendimiento superior seguirá creciendo. Esta evolución permitirá el desarrollo de soluciones de visión más sofisticadas y escalables, abriendo nuevas posibilidades en diversas industrias, desde la atención médica y el transporte hasta la seguridad y el entretenimiento.

Este artículo proporciona una comprensión básica para arquitectos de sistemas e ingenieros, subrayando la necesidad de pruebas y optimización a medida para satisfacer las demandas específicas de cada aplicación. Al considerar cuidadosamente todos los factores involucrados, es posible diseñar sistemas de visión que sean tanto eficientes como capaces de manejar las crecientes demandas de las aplicaciones modernas.