Conseils d’intégration des caméras au niveau de la carte pour les ingénieurs

Choisir l’interface adaptée à l’intégration de caméra au niveau carte

USB 3.1, MIPI CSI-2 et LVDS : compromis entre bande passante, latence et synchronisation en temps réel

Les ingénieurs embarqués sont confrontés à des compromis critiques lors du choix des interfaces pour l’intégration de caméras au niveau des cartes. L’interface USB 3.1 offre un débit élevé (5 Gbps), ce qui la rend adaptée au streaming vidéo HD, mais sa surcharge protocole introduit une latence de 5 à 10 ms, limitant ainsi son adéquation aux boucles de commande en temps réel. MIPI CSI-2 propose un débit évolutif (jusqu’à 6 Gbps par voie) et une synchronisation déclenchée matériellement, permettant une latence inférieure à la milliseconde et un minutage précis entre capteurs multiples — idéal pour l’automatisation industrielle et la robotique. LVDS assure une transmission déterministe et à ultra-basse latence (< 1 ms) via des protocoles sériels simples, bien que son débit par canal soit plafonné à environ 655 Mbps, ce qui restreint son utilisation aux flux de résolution inférieure ou compressés. Les systèmes de vision nécessitant une synchronisation stricte entre caméras doivent privilégier MIPI CSI-2 ; les applications critiques en matière de sécurité, telles que la perception des véhicules autonomes, tirent profit de la prévisibilité temporelle offerte par LVDS. USB 3.1 reste une solution viable pour la surveillance HD à faible coût et non temps réel, lorsque la latence mineure est acceptable — à condition que les contraintes thermiques et de traitement soient validées.

Bonnes pratiques en matière d’intégrité du signal et de conception des cartes de circuits imprimés par Interface

L'intégrité du signal est propre à chaque interface et constitue le fondement d'une performance fiable des caméras au niveau de la carte. Pour l'interface USB 3.1, maintenez une impédance différentielle de 90 Ω avec des paires de pistes de longueur identique (±5 mil), un routage blindé par une masse et une séparation stricte par rapport aux pistes numériques bruyantes afin de supprimer les interférences électromagnétiques (EMI). L'interface MIPI CSI-2 exige une impédance de 100 Ω par voie différentielle, un appariement de longueur des pistes dans une tolérance de ±10 mil et l'évitement des vias à proximité des récepteurs — ce dernier point étant particulièrement critique pour les voies haute vitesse fonctionnant à plus de 1,5 Gbps. Les circuits imprimés LVDS exigent des pistes courtes (< 10 pouces), une impédance constante de 100 Ω et des pistes de garde afin de réduire les couplages parasites. Pour toutes les interfaces, partitionnez les plans de masse afin d'isoler les circuits analogiques du capteur des domaines numériques du processeur de signal d'image (ISP) et du processeur, placez les condensateurs de découplage à moins de 2 mm des broches d'alimentation, et utilisez des empilements de couches comportant au moins 4 couches, avec des plans de référence continus. Un routage inadéquat est à l'origine de 32 % des artefacts d'image observés dans les systèmes de vision prototypes — ce qui rend la simulation post-routage et la validation de l'impédance indispensables pour les conceptions critiques.

Intégration mécanique : montage de l’objectif et flexibilité optique

Le montage précis des lentilles est essentiel : des désalignements à l’échelle du micromètre provoquent une dérive de la mise au point, une distorsion ou une perte de résolution. Les ingénieurs doivent concilier rigidité mécanique — critique pour la résistance aux chocs et aux vibrations — et ajustabilité sur le terrain, généralement obtenue à l’aide de barillets filetés ou de supports à cales. La flexibilité optique exige une compatibilité avec différents types d’objectifs (à mise au point fixe, varifocaux, à lentilles liquides) ainsi que la prise en charge du réglage de la distance focale via des mécanismes hélicoïdaux ou des contrôleurs motorisés. Les différences de dilatation thermique entre les lentilles et les capteurs nécessitent des mesures correctives — par exemple l’utilisation de matériaux à faible coefficient de dilatation thermique (CTE), tels que l’invar ou les composites céramiques, ou encore des montages cinématiques — notamment dans les environnements industriels (-40 °C à +85 °C). Pour l’imagerie infrarouge ou multispécrale, la transparence du matériau du substrat dans la bande spectrale cible (par exemple le germanium pour l’infrarouge lointain, la silice fondue pour l’ultraviolet) devient une contrainte de conception primordiale. Des interfaces modulaires pour objectifs permettent un remplacement rapide sans recalibration complète, mais les tolérances sur la distance de bride doivent rester inférieures à 10 µm afin d’éviter le vignettage ou la dégradation de la fonction de transfert de modulation (MTF).

Garantir une coexistence robuste au niveau système dans les conceptions de caméras au niveau de la carte

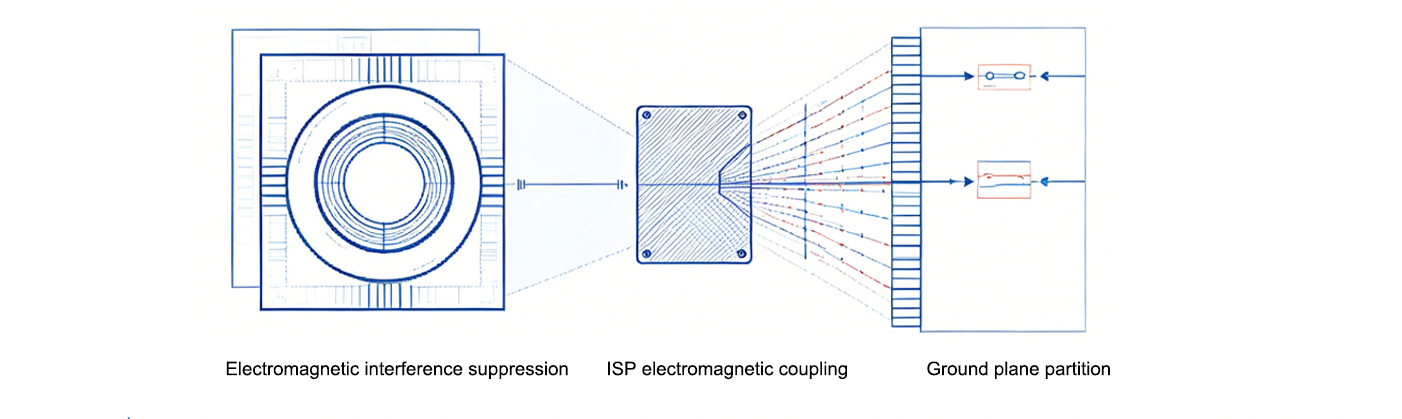

Atténuation des interférences électromagnétiques (EMI) et partitionnement du plan de masse pour la coexistence capteur-ISP

Les conceptions de caméras au niveau des cartes non enveloppées manquent du blindage EMI des modules clos, ce qui accroît la responsabilité liée à l’isolation au niveau de la carte de circuits imprimés (PCB) entre les capteurs d’image et les processeurs de signal d’image (ISP). Des plans de masse partitionnés — séparant les domaines analogiques des capteurs des sous-systèmes numériques de l’ISP — sont essentiels pour minimiser le couplage de bruit conduit, car les interférences mixtes (analogique/numérique) peuvent introduire des harmoniques d’horloge dépassant 50 dBμV/m (IEC 61000-4-3). Parmi les stratégies efficaces figurent la mise à la masse en point étoile à l’entrée d’alimentation, les pistes de garde avec vias de liaison entourant les réseaux numériques haute vitesse, l’évitement des reliefs thermiques dans les remplissages de masse à proximité des capteurs, ainsi que l’ajout de perles de ferrite sur les lignes d’horloge I²C. L’intégrité du signal se dégrade rapidement lorsque la distance entre capteur et ISP devient inférieure à 3λ de la fréquence de fonctionnement la plus élevée — ce qui rend indispensable un routage à impédance contrôlée et des paires différentielles de longueur appariée. La réalisation précoce de prototypes à l’aide de sondes EMI à champ proche (espacement de 5 mm) permet d’identifier les points chauds ; un blindage localisé en mu-métal placé au-dessus des capteurs réduit les émissions rayonnées de 12 à 18 dB (FCC OET-65). Le maintien d’un écart ≥ 40 mil entre les domaines mixtes (analogique/numérique) améliore systématiquement le rapport signal/bruit (SNR) de 20 % dans les modules haute résolution.

Intégration logicielle et portabilité du SDK pour les caméras au niveau carte

Prise en charge des pilotes multiplateformes : Linux RT, QNX et RTOS bare-metal avec Spinnaker

La portabilité logicielle multiplateforme est indispensable pour les déploiements de vision embarquée sur des environnements Linux temps réel (RT), QNX et des systèmes d’exploitation temps réel (RTOS) « bare-metal » à ressources limitées. Chaque système d’exploitation impose des exigences distinctes en matière de temporisation, de mémoire et de modèle de pilotes — tout en exigeant toutefois une acquisition pixel-parfait cohérente et une synchronisation déclenchée par le matériel. Une couche d’abstraction SDK unifiée comble cette lacune : le SDK Spinnaker, par exemple, fournit des API standardisées sur les plateformes x86, ARM et RISC-V, tout en prenant en charge nativement la capture de trames en temps réel, le déclenchement matériel et l’accès aux registres du processeur d’image (ISP). Cela élimine le développement redondant de pilotes lors de la migration depuis des PC industriels sous Linux RT vers des cibles RTOS basées sur microcontrôleur. Les équipes exploitant de tels cadres réduisent leur temps d’intégration jusqu’à 40 %, tout en conservant un comportement déterministe — même dans des conditions de déclassement thermique ou de variation de tension.

Prêt à simplifier l’intégration de vos caméras au niveau carte pour la production OEM ?

Sans Soudure intégration de caméra au niveau carte est la pierre angulaire des systèmes de vision embarquée fiables et hautes performances : aucun algorithme avancé ni aucun matériel de traitement ne peut compenser un choix inadéquat d’interface, des défauts d’intégrité du signal ou une conception mécanique non optimisée. En suivant les meilleures pratiques d’intégration éprouvées sur le terrain et en collaborant avec un fournisseur de caméras proposant du matériel prévalidé, un soutien pour les conceptions de référence et des outils logiciels multiplateformes, vous réduirez le nombre d’itérations de conception, accélérerez le délai de mise sur le marché et débloquerez des performances constantes et rentables dans le cadre d’une production de grande série pour les équipementiers (OEM).

Pour des solutions de caméras au niveau carte destinées aux applications industrielles de vision embarquée, ou pour accéder à des kits complets de conceptions de référence, à une assistance technique interne et à des services de fabrication OEM sur mesure (tels que proposés par HIFLY), associez-vous à un fournisseur doté d’une expertise approfondie dans le domaine industriel de la vision par ordinateur. Les 15 années d’expérience de HIFLY couvrent la conception de caméras au niveau carte, la personnalisation complète OEM/ODM et l’intégration de bout en bout de systèmes de vision embarquée — soutenue par la certification ISO 9001:2015, un accompagnement pour la conformité aux réglementations mondiales et des services dédiés d’ingénierie « design-in ». Contactez-nous dès aujourd’hui pour une consultation sans engagement, la réalisation de prototypes sur mesure ou l’optimisation de votre flux de travail d’intégration de caméras au niveau carte.