เคล็ดลับการผสานรวมกล้องระดับบอร์ดสำหรับวิศวกร

การเลือกอินเทอร์เฟซที่เหมาะสมสำหรับการรวมกล้องระดับบอร์ด

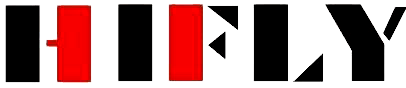

USB 3.1, MIPI CSI-2 และ LVDS: ข้อแลกเปลี่ยนด้านแบนด์วิดธ์ ความหน่วง และการประสานงานแบบเรียลไทม์

วิศวกรฝ่ายฝังตัวต้องเผชิญกับการเลือกระหว่างทางเลือกที่สำคัญอย่างยิ่งเมื่อพิจารณาอินเทอร์เฟซสำหรับการผสานรวมกล้องระดับบอร์ด USB 3.1 ให้แบนด์วิดท์สูง (5 Gbps) จึงเหมาะสำหรับการสตรีมวิดีโอความละเอียดสูง (HD) — แต่ค่าใช้จ่ายของโพรโทคอล (protocol overhead) ทำให้เกิดความล่าช้า 5–10 มิลลิวินาที ซึ่งจำกัดความเหมาะสมในการใช้งานกับลูปควบคุมแบบเรียลไทม์ MIPI CSI-2 ให้แบนด์วิดท์ที่ปรับขนาดได้ (สูงสุด 6 Gbps ต่อเลน) และการซิงโครไนซ์ที่กระตุ้นด้วยฮาร์ดแวร์ ทำให้สามารถบรรลุความล่าช้าต่ำกว่าหนึ่งมิลลิวินาที และการจัดเวลาแบบแม่นยำสำหรับเซนเซอร์หลายตัว — เหมาะอย่างยิ่งสำหรับระบบอัตโนมัติในอุตสาหกรรมและหุ่นยนต์ LVDS ให้การส่งสัญญาณที่แน่นอนและมีความล่าช้าต่ำสุด (<1 มิลลิวินาที) ผ่านโพรโทคอลแบบซีเรียลที่เรียบง่าย แม้กระนั้น แบนด์วิดท์ต่อช่องสัญญาณจะถูกจำกัดไว้ที่ประมาณ 655 Mbps จึงจำกัดการใช้งานเฉพาะกับสตรีมที่มีความละเอียดต่ำหรือสตรีมที่ถูกบีบอัด ระบบทัศนศาสตร์ที่ต้องการการซิงโครไนซ์ระหว่างกล้องอย่างแม่นยำควรให้ความสำคัญกับ MIPI CSI-2 ขณะที่แอปพลิเคชันที่เกี่ยวข้องกับความปลอดภัยอย่างยิ่ง เช่น ระบบการรับรู้สำหรับยานพาหนะอัตโนมัติ จะได้รับประโยชน์จากความสามารถในการคาดการณ์เวลา (timing predictability) ของ LVDS ส่วน USB 3.1 ยังคงเป็นทางเลือกที่ใช้งานได้สำหรับการตรวจสอบวิดีโอ HD แบบไม่เรียลไทม์ที่เน้นต้นทุนต่ำ โดยยอมรับความล่าช้าเล็กน้อยได้ — ภายใต้เงื่อนไขว่าได้มีการตรวจสอบและยืนยันข้อจำกัดด้านความร้อนและการประมวลผลแล้ว

แนวทางปฏิบัติที่ดีที่สุดสำหรับความสมบูรณ์ของสัญญาณและการจัดวางแผงวงจร (PCB) โดย Interface

ความสมบูรณ์ของสัญญาณขึ้นอยู่กับอินเทอร์เฟซแต่ละชนิด และเป็นพื้นฐานสำคัญต่อประสิทธิภาพของกล้องระดับบอร์ดที่เชื่อถือได้ สำหรับ USB 3.1 ต้องรักษาค่าความต้านทานแบบคู่ (differential impedance) ที่ 90 โอห์ม โดยจับคู่เส้นทางสัญญาณให้มีความยาวเท่ากัน (±5 มิล) ใช้การเดินสายแบบมีชั้นกราวด์ป้องกัน (ground-shielded routing) และแยกให้ห่างจากเส้นทางสัญญาณดิจิทัลที่มีสัญญาณรบกวนอย่างเคร่งครัด เพื่อลดการรบกวนแม่เหล็กไฟฟ้า (EMI) ส่วน MIPI CSI-2 ต้องรักษาค่าความต้านทานแบบคู่ที่ 100 โอห์มต่อช่องสัญญาณ (differential lane) จับคู่ความยาวของเส้นทางสัญญาณภายในช่วง ±10 มิล และหลีกเลี่ยงการใช้ไวอาส์ (vias) ใกล้จุดรับสัญญาณ โดยเฉพาะอย่างยิ่งในช่องสัญญาณความเร็วสูงที่ทำงานที่ความเร็วเกิน 1.5 Gbps ส่วนการออกแบบวงจรแบบ LVDS ต้องใช้ความยาวเส้นทางสัญญาณสั้น (<10 นิ้ว) รักษาค่าความต้านทานแบบคู่ที่ 100 โอห์มอย่างสม่ำเสมอ และใช้เส้นทางป้องกัน (guard traces) เพื่อลดการรบกวนข้าม (crosstalk) สำหรับอินเทอร์เฟซทั้งหมด ควรแบ่งพื้นที่กราวด์ออกเป็นส่วนๆ เพื่อแยกวงจรเซนเซอร์แบบแอนะล็อกออกจากโดเมนดิจิทัลของ ISP และโปรเซสเซอร์ วางตัวเก็บประจุแบบลดแรงดัน (decoupling capacitors) ภายในระยะ 2 มม. จากขาจ่ายพลังงาน และใช้โครงสร้างแผ่นวงจร (stackup) ที่มีจำนวนชั้นไม่น้อยกว่า 4 ชั้น พร้อมมีพื้นที่อ้างอิง (reference planes) ที่ต่อเนื่องกัน การเดินสายที่ไม่เหมาะสมเป็นสาเหตุของข้อบกพร่องภาพ (image artifacts) ถึง 32% ในระบบวิชั่นต้นแบบ ดังนั้นการจำลองผลหลังการวางตำแหน่งวงจร (post-layout simulation) และการตรวจสอบค่าความต้านทานแบบคู่ (impedance validation) จึงเป็นสิ่งที่ขาดไม่ได้สำหรับการออกแบบที่มีความสำคัญสูงสุด

การผสานรวมเชิงกล: การติดตั้งเลนส์และความยืดหยุ่นด้านแสง

การติดตั้งเลนส์อย่างแม่นยำเป็นสิ่งจำเป็นอย่างยิ่ง: การจัดแนวที่คลาดเคลื่อนในระดับไมครอนจะก่อให้เกิดปัญหาการเปลี่ยนจุดโฟกัส การบิดเบือนภาพ หรือการสูญเสียความละเอียด วิศวกรจำเป็นต้องรักษาสมดุลระหว่างความแข็งแรงเชิงกล—ซึ่งมีความสำคัญอย่างยิ่งต่อความต้านทานต่อแรงกระแทกและแรงสั่นสะเทือน—กับความสามารถในการปรับแต่งได้ในสนาม ซึ่งโดยทั่วไปจะทำได้ผ่านปลอกเกลียวหรือโครงยึดแบบใช้ชิม ความยืดหยุ่นทางแสงต้องการความเข้ากันได้กับเลนส์หลายประเภท (เลนส์โฟกัสคงที่ เลนส์ปรับโฟกัสได้ และเลนส์ของเหลว) รวมถึงรองรับการปรับความยาวโฟกัสผ่านกลไกแบบเกลียวหรือตัวควบคุมที่ขับเคลื่อนด้วยมอเตอร์ ความไม่สอดคล้องกันของการขยายตัวจากความร้อนระหว่างเลนส์กับเซนเซอร์จำเป็นต้องมีการบรรเทา—โดยใช้วัสดุที่มีสัมประสิทธิ์การขยายตัวตามอุณหภูมิ (CTE) ต่ำ เช่น อินวาร์ หรือคอมโพสิตเซรามิก หรือโครงยึดแบบไคเนมาติก โดยเฉพาะในสภาพแวดล้อมเชิงอุตสาหกรรม (ช่วงอุณหภูมิ -40°C ถึง +85°C) สำหรับการถ่ายภาพอินฟราเรดหรือภาพหลายสเปกตรัม ความโปร่งใสของวัสดุพื้นฐานในช่วงคลื่นเป้าหมาย (เช่น เจอร์เมเนียมสำหรับช่วง LWIR หรือซิลิกาหลอมละลายสำหรับช่วง UV) จะกลายเป็นข้อจำกัดด้านการออกแบบลำดับแรก อินเทอร์เฟซเลนส์แบบโมดูลาร์ช่วยให้สามารถเปลี่ยนเลนส์ได้อย่างรวดเร็วโดยไม่ต้องทำการปรับเทียบใหม่ทั้งหมด แต่ความคลาดเคลื่อนของระยะห่างฟลานจ์ (flange distance) ต้องยังคงอยู่ภายใต้ 10 ไมโครเมตร เพื่อป้องกันไม่ให้เกิดปรากฏการณ์เวนเนตติ้ง (vignetting) หรือการลดลงของค่า MTF

การรับประกันความเข้ากันได้ของระบบในระดับที่มั่นคงสำหรับการออกแบบกล้องในระดับบอร์ด

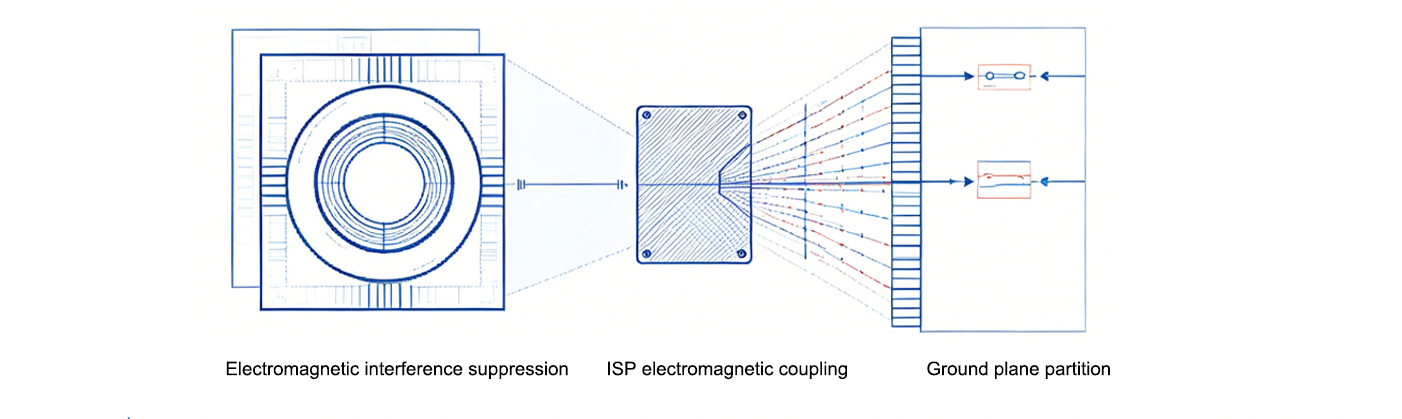

การลดผลกระทบจากสัญญาณรบกวนแม่เหล็กไฟฟ้า (EMI) และการแบ่งพาร์ติชันของแผ่นกราวด์เพลนเพื่อให้เซ็นเซอร์และ ISP ทำงานร่วมกันได้อย่างมีประสิทธิภาพ

การออกแบบกล้องระดับบอร์ดที่ไม่มีเคสครอบนั้นขาดการป้องกันการรบกวนแม่เหล็กไฟฟ้า (EMI) ซึ่งมีอยู่ในโมดูลแบบปิด จึงทำให้ความรับผิดชอบในการแยกสัญญาณระหว่างเซ็นเซอร์ภาพกับหน่วยประมวลผลภาพ (ISP) บนแผงวงจรพิมพ์ (PCB) เพิ่มขึ้นอย่างมีนัยสำคัญ การแบ่งพื้นที่ของชั้นกราวด์ออกเป็นส่วนๆ — โดยแยกโดเมนของเซ็นเซอร์แบบแอนะล็อกออกจากหน่วยย่อยดิจิทัลของ ISP — เป็นสิ่งจำเป็นเพื่อลดการถ่ายโอนสัญญาณรบกวนแบบนำพา (conducted noise coupling) เนื่องจากการรบกวนสัญญาณผสม (mixed-signal interference) อาจก่อให้เกิดฮาร์โมนิกของสัญญาณนาฬิกาที่สูงกว่า 50 dBμV/m (ตามมาตรฐาน IEC 61000-4-3) กลยุทธ์ที่มีประสิทธิภาพ ได้แก่ การต่อกราวด์แบบจุดศูนย์กลาง (star-point grounding) ที่จุดเข้าของแหล่งจ่ายไฟ การใช้เส้นนำสัญญาณป้องกัน (guard traces) พร้อมวายอาส์เชื่อมต่อ (stitching vias) รอบเส้นสัญญาณดิจิทัลความเร็วสูง การหลีกเลี่ยงการใช้ thermal reliefs ในบริเวณที่เทกองกราวด์ใกล้เซ็นเซอร์ และการใส่เฟอร์ไรต์บีด (ferrite beads) ลงบนสายสัญญาณนาฬิกา I²C คุณภาพของสัญญาณจะเสื่อมลงอย่างรวดเร็วเมื่อระยะห่างระหว่างเซ็นเซอร์กับ ISP ลดลงต่ำกว่า 3λ ของความถี่ทำงานสูงสุด ซึ่งจำเป็นต้องใช้เทคนิคการวางเส้นเดินสัญญาณที่ควบคุมอิมพีแดนซ์ (impedance-controlled routing) และคู่สายแบบดิฟเฟอเรนเชียลที่มีความยาวเท่ากัน (matched-length differential pairs) การสร้างต้นแบบเบื้องต้นโดยใช้หัววัด EMI แบบสนามใกล้ (near-field EMI probes) ที่มีระยะห่าง 5 มม. สามารถระบุตำแหน่งที่มีการรบกวนสูง (hotspots) ได้ ส่วนการป้องกันแบบเฉพาะจุดด้วยวัสดุ mu-metal ที่ครอบไว้เหนือเซ็นเซอร์สามารถลดการปล่อยคลื่นแม่เหล็กไฟฟ้าแบบแผ่รังสี (radiated emissions) ได้ 12–18 dB (ตามเอกสาร FCC OET-65) การรักษาระยะห่าง ≥40 mil ระหว่างโดเมนสัญญาณผสมอย่างสม่ำเสมอ จะช่วยปรับปรุงอัตราส่วนสัญญาณต่อสัญญาณรบกวน (SNR) ได้ถึง 20% สำหรับโมดูลความละเอียดสูง

การผสานซอฟต์แวร์และความสามารถในการย้ายถ่าย SDK สำหรับกล้องระดับบอร์ด

การรองรับไดรเวอร์ข้ามแพลตฟอร์ม: Linux RT, QNX และ Bare-Metal RTOS พร้อม Spinnaker

ความสามารถในการย้ายซอฟต์แวร์ข้ามแพลตฟอร์มเป็นสิ่งจำเป็นอย่างยิ่งสำหรับการใช้งานระบบวิชั่นแบบฝังตัว (embedded vision) ที่ทำงานบนหลายระบบปฏิบัติการ ได้แก่ Linux Real-Time (RT), QNX และระบบปฏิบัติการแบบ real-time ที่ไม่มี kernel (bare-metal RTOS) ซึ่งมีข้อจำกัดด้านทรัพยากร โดยแต่ละระบบปฏิบัติการกำหนดข้อกำหนดที่แตกต่างกันในด้านเวลา การจัดการหน่วยความจำ และรูปแบบไดรเวอร์ — อย่างไรก็ตาม คุณสมบัติสำคัญ เช่น การรับภาพที่แม่นยำทุกพิกเซล (pixel-perfect acquisition) และการประสานงานแบบฮาร์ดแวร์ทริกเกอร์ (hardware-triggered synchronization) ต้องคงไว้ให้เหมือนเดิมเสมอ ชั้นนามธรรมของ SDK แบบรวมศูนย์ (unified SDK abstraction layer) ทำหน้าที่เชื่อมช่องว่างนี้: ตัวอย่างเช่น Spinnaker SDK มอบ API มาตรฐานที่รองรับทั้งแพลตฟอร์ม x86, ARM และ RISC-V พร้อมสนับสนุนการจับเฟรมแบบ real-time การทริกเกอร์ด้วยฮาร์ดแวร์ และการเข้าถึงรีจิสเตอร์ของ ISP (Image Signal Processor) อย่างเนทีฟ ซึ่งช่วยขจัดความจำเป็นในการพัฒนาไดรเวอร์ซ้ำซ้อนเมื่อย้ายการใช้งานจากคอมพิวเตอร์อุตสาหกรรมที่ใช้ Linux RT ไปยังเป้าหมายที่ใช้ไมโครคอนโทรลเลอร์พร้อม RTOS ทีมงานที่ใช้เฟรมเวิร์กเช่นนี้สามารถลดระยะเวลาการผสานรวม (integration time) ลงได้สูงสุดถึง 40% ขณะยังคงรักษาพฤติกรรมแบบ deterministic ไว้ได้อย่างมั่นคง แม้ในสภาวะที่เกิดการลดประสิทธิภาพจากความร้อน (thermal derating) หรือการปรับระดับแรงดันไฟฟ้า (voltage scaling)

พร้อมที่จะปรับกระบวนการผสานรวมกล้องระดับบอร์ด (board level camera integration) ให้มีประสิทธิภาพมากยิ่งขึ้นเพื่อการผลิต OEM หรือยังไม่?

ไม่มีรอยต่อ การผสานรวมกล้องระดับบอร์ด เป็นรากฐานสำคัญของระบบการมองเห็นแบบฝังตัวที่มีความน่าเชื่อถือและประสิทธิภาพสูง—ไม่ว่าจะเป็นอัลกอริธึมขั้นสูงหรือฮาร์ดแวร์ประมวลผลใด ๆ ก็ไม่สามารถชดเชยข้อบกพร่องจากการเลือกอินเทอร์เฟซที่ไม่เหมาะสม ปัญหาความสมบูรณ์ของสัญญาณ หรือการออกแบบเชิงกลที่ยังไม่ได้ปรับให้เหมาะสมได้ ด้วยการปฏิบัติตามแนวทางการผสานรวมที่พิสูจน์แล้วในภาคสนาม และการร่วมมือกับผู้จัดจำหน่ายกล้องที่ให้บริการฮาร์ดแวร์ที่ผ่านการตรวจสอบและรับรองล่วงหน้า สนับสนุนการออกแบบอ้างอิง และเครื่องมือซอฟต์แวร์ที่ใช้งานได้ข้ามแพลตฟอร์ม คุณจะสามารถลดจำนวนรอบการออกแบบ เร่งระยะเวลาในการนำผลิตภัณฑ์ออกสู่ตลาด และปลดล็อกประสิทธิภาพที่สม่ำเสมอและคุ้มค่าต้นทุนสำหรับการผลิตจำนวนมากในโรงงานผู้ผลิตรถยนต์ (OEM)

สำหรับโซลูชันกล้องระดับบอร์ดที่มีคุณภาพสำหรับอุตสาหกรรม ซึ่งออกแบบมาเฉพาะสำหรับแอปพลิเคชันการมองเห็นแบบฝังตัวของคุณ หรือเพื่อเข้าถึงชุดการออกแบบอ้างอิงแบบครบวงจร บริการสนับสนุนวิศวกรรมภายในองค์กร และบริการผลิตแบบ OEM แบบกำหนดเอง (ตามที่ HIFLY ให้บริการ) โปรดร่วมงานกับผู้ให้บริการที่มีความเชี่ยวชาญลึกซึ้งด้านระบบการมองเห็นด้วยเครื่องจักรสำหรับอุตสาหกรรม ประสบการณ์ 15 ปีของ HIFLY ครอบคลุมการออกแบบกล้องระดับบอร์ด การปรับแต่งแบบ OEM/ODM อย่างสมบูรณ์ และการรวมระบบการมองเห็นแบบฝังตัวแบบครบวงจร — พร้อมรับรองมาตรฐาน ISO 9001:2015 การสนับสนุนด้านการปฏิบัติตามข้อกำหนดด้านกฎระเบียบระดับโลก และบริการวิศวกรรมเพื่อการนำเข้าสู่การออกแบบ (design-in engineering) ที่มีความเฉพาะเจาะจง ติดต่อเราได้ทันทีวันนี้ เพื่อรับคำปรึกษาโดยไม่มีภาระผูกพัน การสร้างต้นแบบแบบกำหนดเอง หรือเพื่อปรับปรุงกระบวนการทำงานในการผสานรวมกล้องระดับบอร์ดของคุณ