Maschinelles Sehen zur Konturerkennung

In Zeiten der Industrie 4.0 und intelligenter Automatisierung ist die maschinelle Bildverarbeitung zu einer Schlüsseltechnologie geworden, die es Maschinen ermöglicht, visuelle Daten präzise „zu sehen" und zu interpretieren – oftmals mit einer Genauigkeit, die menschliche Fähigkeiten übertrifft. Eines ihrer zentralen Funktionen ist dabei konturerkennung die Konturerkennung: Sie extrahiert die Formen von Objektgrenzen aus digitalen Bildern und bildet die Grundlage für Aufgaben wie Objekterkennung, Maßvermessung, Fehlerprüfung und robotergestützte Manipulation.

1. Was ist Konturerkennung?

Ein „Kontur" in der Bildverarbeitung ist eine Kurve, die zusammenhängende Punkte (entlang der Grenze eines Objekts) mit gleicher Helligkeit oder Farbe verbindet und das Objekt von seinem Hintergrund abgrenzt. Im Gegensatz zu diskreten Kanten (Helligkeitswechsel auf Pixelebene) sind Konturen durchgängige Schleifen (oder offene Kurven für teilweise sichtbare Objekte), die die Form eines Objekts repräsentieren – form und nicht nur isolierte Helligkeitsveränderungen.

Das Hauptziel der Konturerkennung besteht darin, Bilddaten zu vereinfachen: Die Reduzierung eines 2D-Bildes auf 1D-Konturlinien ermöglicht es Maschinen, die Geometrie eines Objekts (Größe, Winkel, Symmetrie) effizient zu analysieren, ohne jeden Pixel verarbeiten zu müssen – unerlässlich für Echtzeitanwendungen, bei denen Geschwindigkeit und Genauigkeit gleichermaßen wichtig sind.

2. Grundlegende Prinzipien

Die Konturerkennung basiert auf zwei wesentlichen Schritten: vorverarbeitung (Verbesserung des Kontrasts zwischen Objekt und Hintergrund) und kontur-Extraktion (Identifizierung von Randpunkten). Diese Schritte beheben Fehler in Rohbildern wie Rauschen, ungleichmäßige Beleuchtung oder geringer Kontrast, die Grenzen verschleiern.

2.1 Vorverarbeitung

Rohbilder weisen selten klare Grenzen auf, daher ist die Vorverarbeitung entscheidend:

Graustufen-Konvertierung : Die meisten Algorithmen verwenden einkanalige Graustufenbilder (Vereinfachung der Daten von drei RGB-Kanälen auf einen, da Farbe oft irrelevant ist).

Lärmmminderung : Gaußsches Weichzeichnen glättet Bilder mit einem Gaußschen Kernel, unterdrückt hochfrequentes Rauschen und bewahrt dabei wichtige Helligkeitsverläufe – entscheidend, um falsche Kanten durch Sensorstörungen oder Lichtfluktuationen zu vermeiden.

Kantenerkennung : Erkennt pixelweise Helligkeitsveränderungen (Kanten), aus denen Konturen aufgebaut werden. Die Canny-Kantendetektion (ein mehrstufiges Verfahren: Glättung, Gradientenberechnung, Nicht-Maxima-Unterdrückung, Hysterese-Schwellwertverfahren) ist der Goldstandard und liefert dünne, zusammenhängende Kanten. Der Sobel-Operator, der horizontale/vertikale Kanten hervorhebt, eignet sich für dickere Kantenbereiche.

Schwellwertverfahren : Wandelt Graustufen-Kantenkarten in binäre (schwarz/weiß) Bilder um, wobei die Vordergrundkanten (Objektkanten) als 1 und der Hintergrund als 0 definiert werden – dies vereinfacht das Verfolgen von Konturen.

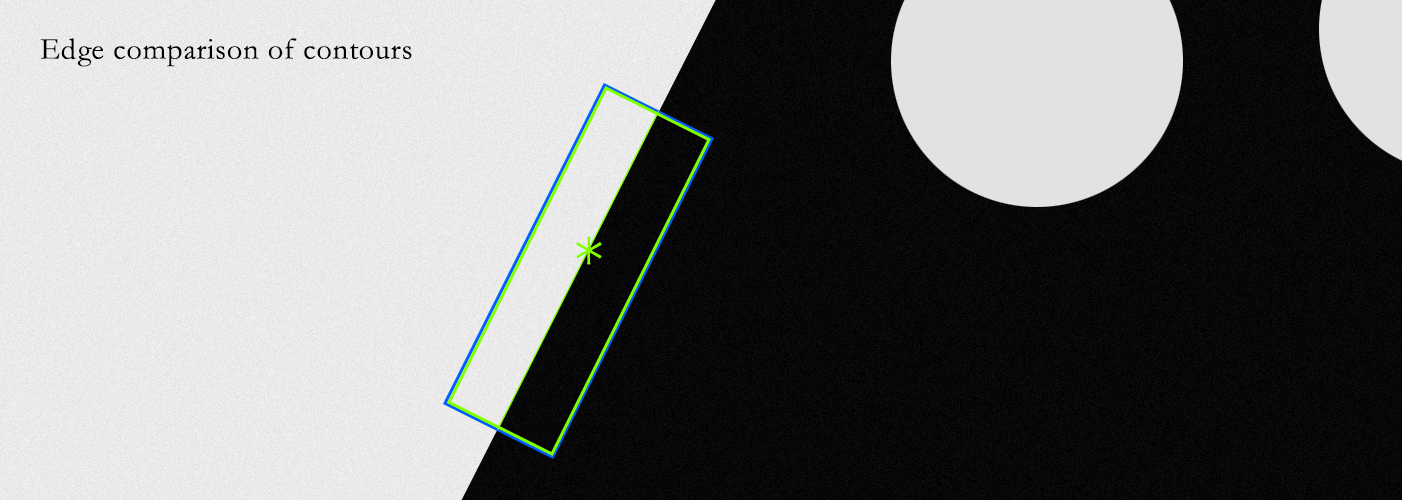

2.2 Konturverfolgung

Nach der Vorverarbeitung verfolgen Algorithmen verbundene Vordergrundpixel, um Konturen zu bilden. Die Freeman Chain Code wird häufig verwendet: Sie repräsentiert Konturen als Richtungscodes (oben, unten, links, rechts) relativ zum vorherigen Pixel, reduziert den Speicherbedarf und ermöglicht einen einfachen Formenvergleich. Bibliotheken wie OpenCV vereinfachen dies mit Funktionen wie findContours(), die die Konturkoordinaten der Pixel zurückgibt und das Filtern (nach Fläche oder Seitenverhältnis) erlaubt, um Rauschen zu entfernen.

3. Fortgeschrittene Techniken

Traditionelle Methoden funktionieren in kontrollierten, kontrastreichen Umgebungen, doch reale Szenarien (ungleichmäßige Beleuchtung, überlappende Objekte) benötigen fortgeschrittene Ansätze:

Adaptive Schwellwertbildung : Berechnet lokale Schwellwerte für jedes Pixel (im Gegensatz zu einem einzigen globalen Schwellwert), ideal für Bilder mit wechselnder Beleuchtung (z. B. industrielle Bauteile unter Fabriksbeleuchtung).

Konturerkennung auf Basis von Deep Learning : Convolutional Neural Networks (CNNs) extrahieren direkt aus Rohbildern Grenzen, ohne manuelle Vorverarbeitung. Modelle wie HED (Holistically-Nested Edge Detector) und RCF (Richer Convolutional Features) verschmelzen mehrskalige CNN-Merkmale für hochaufgelöste Kantenkarten, hervorragend geeignet für komplexe Szenen (medizinische Bilder, unordentliche Umgebungen).

4. Hauptsächliche Herausforderungen

Trotz Fortschritten bleiben praktische Hürden bestehen:

Rauschen und Beleuchtung : Fabrikhallen, schlechte Beleuchtung oder Außensituationen führen zu unterbrochenen/falschen Konturen.

Objekte mit Überlappung/Verdeckung : Gesteckte Teile verschmelzen zu Konturen, wodurch individuelle Formen schwer unterscheidbar sind.

Transparente/reflektierende Materialien : Glas oder Metall streut Licht, wodurch schwache/verzerrte Kanten entstehen.

Echtzeitleistung : Industrielle Aufgaben (Montagelinieninspektion) erfordern 30+ Bilder pro Sekunde (FPS). Tiefgangige Lernmodelle benötigen Optimierung (Quantisierung, GPU-Beschleunigung), um die Geschwindigkeitsanforderungen zu erfüllen.

5. Anwendungen in der realen Welt

Konturerkennung treibt die Automatisierung in verschiedenen Branchen voran:

Industriequalitätskontrolle : Prüfung auf Defekte (Risse, Dellen) in der Fertigung. Beispielsweise überprüft die Automobilproduktion, ob Motorkomponenten (Zahnräder, Dichtungen) mit den vorgegebenen Konturen übereinstimmen und lehnt Teile mit Abweichungen ab.

Roboterbasiertes Greifen und Platzieren : Hilft Robotern dabei, Objekte zu lokalisieren. In Lagerhallen nutzen Roboterarme Konturen, um Pakete auf Förderbändern zu erkennen, deren Mittelpunkt/Ausrichtung zu berechnen und den Griff anzupassen.

Medizinischen Bildgebungs- : Segmentiert anatomische Strukturen (Tumore in CT-Bildern, Zellgrenzen in Gewebeschnitten), um die Diagnose zu unterstützen. Deep-Learning-Modelle bewältigen variable biologische Gewebe effektiv.

Landwirtschaft : Sortiert Früchte (Äpfel, Orangen) nach Größe/Reife mithilfe der Konturanalyse und erkennt Pflanzenkrankheiten anhand von Veränderungen an Blattkonturen.

Verkehrsüberwachung : Verfolgt Fahrzeuge, misst den Verkehrsfluss oder identifiziert Unfälle (mittels ungewöhnlicher Konturen oder unbeweglicher Objekte) über Überwachungskameras.

6. Zukünftige Trends

Drei Trends werden die Konturerkennung prägen:

Edge-AI-Integration : Leichtgewichtsmodelle (quantisierte CNNs) auf Edge-Geräten (Industriekameras, Drohnen) ermöglichen die Echtzeitverarbeitung ohne Abhängigkeit von der Cloud – entscheidend für autonome Roboter.

Multimodale Fusion : Die Kombination von visuellen Daten mit LiDAR/Thermografie verbessert die Erkennung unter schwierigen Bedingungen (z. B. Thermografie verbessert die Konturen bei schlechten Lichtverhältnissen; LiDAR liefert eine 3D-Tiefe für überlappende Objekte).

Erklärbare KI (XAI) : XAI-Techniken werden verdeutlichen, wie Deep-Learning-Modelle Konturen erkennen, und so das Vertrauen in kritischen Bereichen (medizinische Diagnose, Luftfahrtinspektion) stärken.

Fazit

Die Konturerkennung durch maschinelles Sehen verbindet Rohbilddaten mit handlungsleitenden Erkenntnissen und treibt so Automatisierung und Qualitätskontrolle voran. Von der traditionellen Kantenerkennung bis hin zum Deep Learning hat sie sich weiterentwickelt, um komplexe Herausforderungen zu bewältigen. Mit dem technologischen Fortschritt wird sie weiterhin eine zentrale Rolle in intelligenten Systemen spielen und Maschinen in verschiedenen Branchen leistungsfähiger und zuverlässiger machen.